EU AI Act

Rechtliche Rahmenbedingungen: EU AI Act und regulatorische Anforderungen

Inhaltsverzeichnis

- 1 Einleitung & Zielsetzung

- 2 Umsetzung & Anwendbarkeit

- 3 Risikoklassen im Detail

- 4 Herausforderungen & Kritikpunkte

- 5 Potenziale & Chancen

- 6 Best Practices & Empfehlungen

- 7 Ausblick

1 Einleitung & Zielsetzung

Der EU AI Act (Verordnung (EU) 2024/1689) ist das weltweit erste umfassende Gesetz zur Regulierung von Künstlicher Intelligenz (KI). Ziel ist es, ein vertrauenswürdiges KI-Ökosystem in Europa zu schaffen, das Sicherheit, Grundrechte und europäische Werte wahrt, gleichzeitig aber Innovation und Investitionen fördert. Kern des Gesetzes ist ein risikobasierter Ansatz, der KI-Systeme in vier Risikoklassen einteilt: inakzeptabel, hoch, begrenzt und minimal. Für jede Risikoklasse gelten abgestufte Anforderungen. Der Gesetzgebungsprozess wurde durch globale politische Entwicklungen, technologische Dynamik und zunehmende gesellschaftliche Debatten beschleunigt. Der AI Act ist Teil der Digitalstrategie der EU und steht im Kontext internationaler Regulierungsbemühungen.

2 Umsetzung & Anwendbarkeit

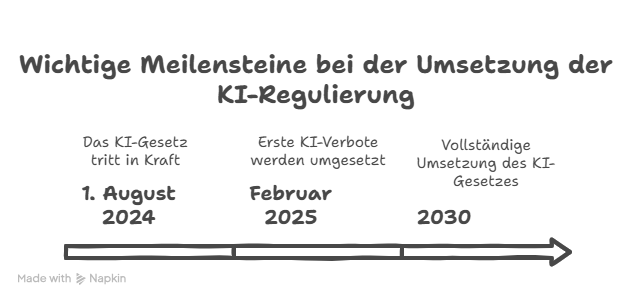

Das Gesetz trat am 1. August 2024 in Kraft. Die Anwendung erfolgt gestaffelt bis 2030. Erste Verbote (z. B. manipulative KI, Social Scoring) gelten seit Februar 2025. Für Hochrisiko-KI-Systeme sind lange Übergangsfristen vorgesehen. Mitgliedstaaten müssen zuständige Behörden benennen, Sandkästen einrichten und über notwendige Ressourcen verfügen. Bisher zeigen sich Unterschiede im Umsetzungsstand. Auf EU-Ebene übernimmt das European AI Office zentrale Aufgaben, insbesondere bei General Purpose AI (GPAI). Die nationale Umsetzung variiert stark, was Risiken für Fragmentierung birgt. Sandkästen sollen Innovation fördern, insbesondere bei KMU.

3 Risikoklassen im Detail

Der risikobasierte Ansatz ist das zentrale Steuerungsinstrument des EU AI Acts. KI-Systeme werden in vier Klassen eingestuft, je nach potenzieller Auswirkung auf Sicherheit, Grundrechte und gesellschaftliche Werte:

-

Inakzeptables Risiko: KI-Systeme, die gegen Werte der EU verstoßen oder erhebliche Risiken für Individuen bergen, sind verboten. Beispiele: Social Scoring durch Behörden, Echtzeit-Gesichtserkennung im öffentlichen Raum (außer in engen Ausnahmefällen).

-

Hohes Risiko: Systeme in sensiblen Bereichen wie Bildung, Justiz, Strafverfolgung, Gesundheit oder kritischen Infrastrukturen. Sie unterliegen umfangreichen Anforderungen wie Risikomanagement, Dokumentationspflichten, menschlicher Aufsicht und hoher Datenqualität. Diese Systeme müssen vor dem Einsatz ein Konformitätsbewertungsverfahren durchlaufen.

-

Begrenztes Risiko: Systeme mit potenziellen Transparenzrisiken, wie Chatbots oder Deepfake-Generatoren. Hier bestehen Informationspflichten gegenüber Nutzer:innen, z. B. Kennzeichnung, dass Inhalte KI-generiert sind.

-

Minimales Risiko: Die Mehrheit aller KI-Anwendungen (z. B. Spamfilter, Empfehlungssysteme für Streaming-Dienste) fällt in diese Kategorie. Es gelten keine verpflichtenden Anforderungen, freiwillige Verhaltenskodizes werden jedoch gefördert.

Diese Einteilung ermöglicht eine differenzierte Regulierung: Statt alle KI-Technologien über einen Kamm zu scheren, werden Anforderungen gezielt dort angesetzt, wo die potenziellen Gefahren für Individuum und Gesellschaft am größten sind.

4 Herausforderungen & Kritikpunkte

Zentrale Herausforderungen:

-

Unklare Begriffsdefinitionen: Begriffe wie “KI-System”, “systemisches Risiko” oder “enge verfahrenstechnische Aufgabe” sind interpretationsbedürftig.

-

Risikoklassifizierung: Die Einstufung als Hochrisiko-System ist teils unklar. Die Ausnahmeregelung nach Art. 6(3) wird als potenzielles Schlupfloch kritisiert.

-

GPAI-Regulierung: Neue Regeln für Basismodelle wie GPT-4 sind komplex. Kritik gibt es an Schwellenwerten, Transparenzpflichten und Umsetzbarkeit.

-

Grundrechtslücken: Zivilgesellschaftliche Organisationen bemängeln Ausnahmen für Sicherheitsbehörden und unzureichenden Schutz z. B. im Migrationskontext.

-

Durchsetzbarkeit: Behörden mangelt es oft an Ressourcen und Expertise. Die komplexe Governance-Struktur erhöht die Anforderungen an Koordination.

-

Wirtschaftliche Sorgen: Unternehmen kritisieren hohe Compliance-Kosten, vage Formulierungen und potenzielle Innovationshemmnisse.

5 Potenziale & Chancen

Trotz der Kritik birgt der AI Act bedeutende Potenziale:

-

Rechtssicherheit: Einheitliche Regeln erleichtern die Planung und Investition für Unternehmen.

-

Marktchancen: Es entsteht ein Markt für vertrauenswürdige KI-Produkte, der als Qualitätsmerkmal dienen kann.

-

Neue Dienstleistungen: Nachfrage nach Compliance-Tools, Auditierung, Governance-Frameworks und Ethikberatung steigt.

-

Standardisierung: Harmonisierte technische Normen könnten auch international prägend wirken.

-

Weltweite Vorreiterrolle: Der “Brussels Effect” – die globale Strahlkraft europäischer Regulierung – könnte KI-Regelsetzung weltweit beeinflussen.

6 Best Practices & Empfehlungen

Empfohlene Maßnahmen für die Umsetzung:

-

Frühzeitige Systeminventur: Unternehmen sollten ihre KI-Systeme erfassen und frühzeitig risikobasiert einstufen.

-

Governance-Modelle etablieren: Aufbau interner Compliance-Strukturen, idealerweise unter Einbeziehung bestehender DSGVO-Frameworks.

-

Transparenz und Dokumentation: Verfahrensdokumentation, Modellkarten, Bias-Tests und menschliche Aufsicht sind essenziell.

-

Nutzung von Sandkästen: Besonders für KMU eine Möglichkeit, Innovation rechtskonform zu testen.

-

Offene Kommunikation: Stakeholder-Dialoge und partizipative Gestaltung erhöhen Akzeptanz und Wirksamkeit.

7 Ausblick

Der langfristige Erfolg des EU AI Acts wird davon abhängen, ob es gelingt, die Balance zwischen Regulierung und Innovationsförderung zu halten. Die praktische Durchsetzbarkeit, die Kohärenz mit anderen EU-Gesetzen (z. B. DSGVO, Data Act, DSA) sowie die internationale Anschlussfähigkeit werden entscheidend sein. Wichtig wird auch sein, wie flexibel der AI Act auf technologische Entwicklungen reagieren kann und ob er Vertrauen in KI langfristig stärkt.

Version: 1.0

Stand: Januar 2026

Kurs: Machine Learning. Verstehen. Anwenden. Gestalten.